Aprendizaje profundo mejora interpretación de ecografía de pulmón

Actualizado el 20 Feb 2024

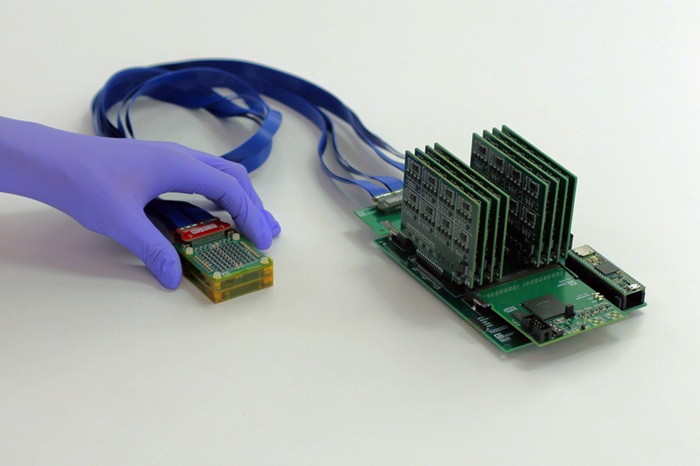

La ecografía pulmonar (EGP) se ha convertido en una herramienta valiosa para la evaluación de la salud pulmonar debido a su seguridad y rentabilidad. Sin embargo, el desafío de interpretar imágenesde EGP, en gran parte debido a su dependencia de artefactos, genera variabilidad entre los operadores y obstaculiza su aplicación más amplia. Ahora, un nuevo estudio ha descubierto que el aprendizaje profundo puede mejorar la interpretación en tiempo real de la ecografía pulmonar. Este estudio encontró que un modelo de aprendizaje profundo entrenado en imágenes de ultrasonido pulmonar era capaz de segmentar e identificar artefactos en estas imágenes, como se demostró en pruebas en un modelo fantasma.

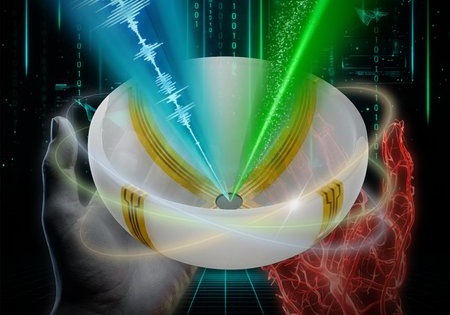

En el estudio, investigadores de la Universidad de Leeds (West Yorkshire, Reino Unido) emplearon una técnica de aprendizaje profundo para la segmentación multiclase en imágenes de ultrasonido de un fantasma de pulmón para entrenamiento. Esta técnica se utilizó para distinguir diversos objetos y artefactos, como costillas, líneas pleurales, líneas A, líneas B y confluencias de líneas B. El equipo desarrolló una versión modificada de la arquitectura U-Net para la segmentación de imágenes, con el objetivo de lograr un equilibrio entre la velocidad y la precisión del modelo. Durante la fase de entrenamiento, implementaron un proceso de aumento específico de ultrasonido para mejorar la capacidad del modelo para generalizar datos nuevos e invisibles, como transformaciones geométricas y aumentos específicos de ultrasonido. Luego, la red entrenada se aplicó para segmentar transmisiones de imágenes en vivo desde un sistema de ultrasonido en el punto de atención (POCUS) basado en un carrito, utilizando un transductor de matriz curva convexa para obtener imágenes del fantasma de entrenamiento y de los cuadros de flujo. El modelo, entrenado en una única unidad de procesamiento de gráficos, requirió unos 12 minutos de entrenamiento con 450 imágenes de ultrasonido.

El modelo demostró una alta tasa de precisión del 95,7 %, con puntuaciones de coeficiente de similitud de Dice de moderadas a altas. La aplicación en tiempo real del modelo a hasta 33,4 fotogramas por segundo mejoró significativamente la visualización de imágenes de ecografía pulmonar. Además, el equipo evaluó la correlación de píxeles entre las máscaras de segmentación etiquetadas manualmente y predichas por el modelo. A través de una matriz de confusión normalizada, observaron que el modelo predijo con precisión el 86,8 % de los píxeles etiquetados como costillas, el 85,4 % para la línea pleural y el 72,2 % para la confluencia de la línea B. Sin embargo, predijo correctamente sólo el 57,7 % de los píxeles de la línea A y el 57,9 % de los píxeles de la línea B.

Además, los investigadores emplearon el aprendizaje por transferencia con su modelo, utilizando el conocimiento de un conjunto de datos para mejorar el entrenamiento en un conjunto de datos relacionado. Este método arrojó coeficientes de similitud de Dice de 0,48 para derrame pleural simple, 0,32 para consolidación pulmonar y 0,25 para la línea pleural. Los hallazgos sugieren que este modelo podría ayudar en el entrenamiento de ultrasonido pulmonar y ayudar a cerrar las brechas de habilidades. Los investigadores también propusieron una medida semicuantitativa, la puntuación de artefactos de la línea B, que estima el porcentaje de un espacio intercostal ocupado por las líneas B. Esta medida podría estar potencialmente relacionada con la gravedad de las afecciones pulmonares.

"El trabajo futuro debería considerar la traducción de estos métodos a datos clínicos, considerando el aprendizaje por transferencia como un método viable para construir modelos que puedan ayudar en la interpretación de la ecografía pulmonar y reducir la variabilidad entre operadores asociada con esta técnica de imagen subjetiva", afirmaron los investigadores. .

Enlaces relacionados:

Universidad de Leeds