Imágenes sintetizadas de rayos X para capacitación de programas de IA

Por el equipo editorial de MedImaging en español

Actualizado el 08 Aug 2018

Un nuevo estudio describe cómo se pueden usar los rayos X generados por computadora para aumentar los conjuntos de entrenamiento de la inteligencia artificial (IA).Actualizado el 08 Aug 2018

Para generar y mejorar continuamente las radiografías artificiales, los investigadores de la Universidad de Toronto (Canadá) utilizaron algoritmos de red adversarial generativa profunda convolucional (DCGAN, por sus siglas en inglés), que están formados por dos redes: una que genera las imágenes, y la otra que intenta discriminar las imágenes sintéticas de las imágenes reales. Las dos redes se entrenan continuamente hasta que alcanzan un punto en el que el discriminador no puede diferenciar las imágenes reales de las sintetizadas. Una vez que se crea una cantidad suficiente de rayos X artificiales, se utilizan para entrenar a otro DCGAN que puede clasificar las imágenes en consecuencia.

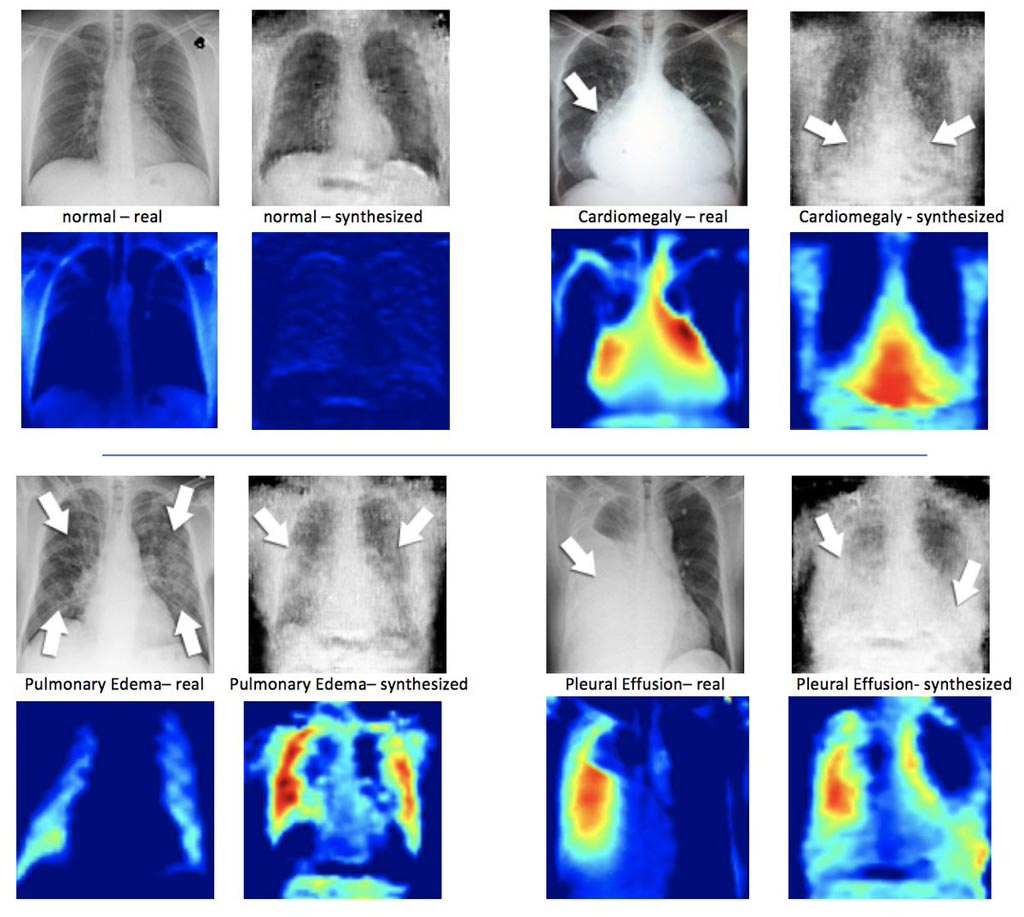

Imagen: Rayos X (I) junto a una radiografía sintetizada creada por DCGAN. Debajo de las imágenes de rayos X se encuentran los mapas de calor correspondientes (Fotografía cortesía de Hojjat Salehinejad/MIMLab).

Luego, los investigadores compararon la exactitud del conjunto de datos aumentado artificialmente con el original cuando se alimentaron a través de su sistema de IA, y encontraron que la exactitud de clasificación mejoró en un 20% para las condiciones comunes. Para algunas condiciones raras, la exactitud mejoró hasta un 40%. Una ventaja del método es que como los rayos X sintéticos no son reales, el conjunto de datos puede estar fácilmente disponible para los investigadores fuera de las instalaciones del hospital sin violar las preocupaciones de privacidad. El estudio fue presentado en la Conferencia Internacional de IEEE sobre Acústica, Procesamiento de Voz y Señales, celebrada en abril de 2018 en Calgary (Canadá).

“En cierto sentido, utilizamos el aprendizaje automático para hacer aprendizaje automático”, dijo el autor principal y presentador del estudio, el profesor Shahrokh Valaee, PhD, del Laboratorio de Inteligencia Artificial en Medicina (MIMLab). “Creamos radiografías simuladas que reflejan ciertas condiciones raras para que podamos combinarlas con rayos X reales y poder tener una base de datos lo suficientemente grande como para entrenar las redes neuronales para identificar estas afecciones en otros rayos X”.

“El aprendizaje profundo solo funciona si el volumen de datos de entrenamiento es lo suficientemente grande, y esta es una forma de garantizar que tengamos redes neuronales que puedan clasificar imágenes con alta precisión”, concluyó el profesor Valaee. “Hemos podido demostrar que los datos artificiales generados por GAN convolucionales profundas se pueden utilizar para aumentar los conjuntos de datos reales. Esto proporciona una mayor cantidad de datos para el entrenamiento y mejora el desempeño de estos sistemas en la identificación de condiciones raras”.

Guided Devices.jpg)